この投稿はDockerとArmの共同作業で、Docker MCP ToolkitとArm MCP Serverがどのように連携してHugging Face Spacesをスキャンし、Arm64 準備状態を整えるかを実演します。

前回の投稿では、AVXの内在要素を含むレガシーC++アプリケーションをArm264に移行する方法を、Docker MCP ToolkitとArm MCP Serverを用いて解説しました。コード変換、SIMDの本質的な書き換え、コンパイラフラグの変更、フルスタックなどです。この投稿は、より異なる、そしてはるかに一般的な故障モードについてです。

ACE-Stepと15を実行しようとしたとき、3。Hugging FaceのBパラメータ音楽生成モデル5、Arm64 MacBook上でインストールが失敗しました。これは謎めいたカーネルエラーではなく、pipエラーで失敗しました。requirements.txtのフラッシュアタッチホイールは linux_x86_64 URLにハードコードされており、そのアドレスにはArm64 ホイールは存在せず、コンテナは構築されませんでした。一見単純な問題ですが、Hugging Face Docker Spacesの約 80%に影響が出ています。コードでもDockerファイルでもなく、誰も気づかなかった単一のハードコード依存関係URLに影響しています。なぜなら誰もArmでテストしていないからです。

これを体系的に診断するために、約15分で腕64準備状況のハギングフェイススペースを解析できる7ツールMCPチェーンを構築しました。このガイドの終わりには、なぜACE-Step v1なのかがよく理解できるでしょう。5アーム64、2つの特定のブロッカー、そしてチェーンがそれらを自動的に表に出す方法で失敗します。

なぜ顔のスペースを抱きしめることが腕にとって重要なのか

Hugging Faceは100万以上のスペースをホストしており、その多くはDocker SDKを使用しているため、開発者はDockerfileを作成し、HuggingFaceが直接コンテナを構築し提供します。問題は、これらのコンテナのほとんどがLinux/AMD64上でのみ構築・テストされていたことであり、これによりAIワークロードにとってますます重要になっている3つの急成長64 ターゲットの展開壁が生まれています。

|

ターゲット |

ハードウェア |

なぜ重要なのか |

|---|---|---|

|

クラウド |

AWS Graviton, Azure Cobalt, Google Axion |

20-40%のコスト削減、x個86 |

|

エッジ/ロボティクス |

NVIDIA ジェットソン・ソー、DGX Spark |

GR00T、ルロボット、アイザックは全員アーム64を狙う |

|

ローカル開発者 |

Apple Silicon M1-M4 |

最も人気のある開発者マシン、クラウドコストゼロ |

故障モードは必ずしも明らかではなく、通常は2つの明確なパターンのいずれかで現れます。一つ目はコンテナマニフェストが欠落していることです。イメージにはアーム64 レイヤーがなく、Dockerがそれを取得しようとしませんが、少なくとも診断は簡単です。2つ目は見つけにくいです。Dockerファイルとベースイメージは問題ありませんが、requirements.txtの依存関係がプラットフォーム固有のホイールURLを指し示しています。ビルドは開始され、PIPインストールに到達しましたが、どこを見ればよいか明確な指示のないプラットフォームミスマッチエラーで失敗します。ACE-Step v1。5 は2つ目のパターンの教科書的な例であり、MCPチェーンは両方を数分でキャッチします。

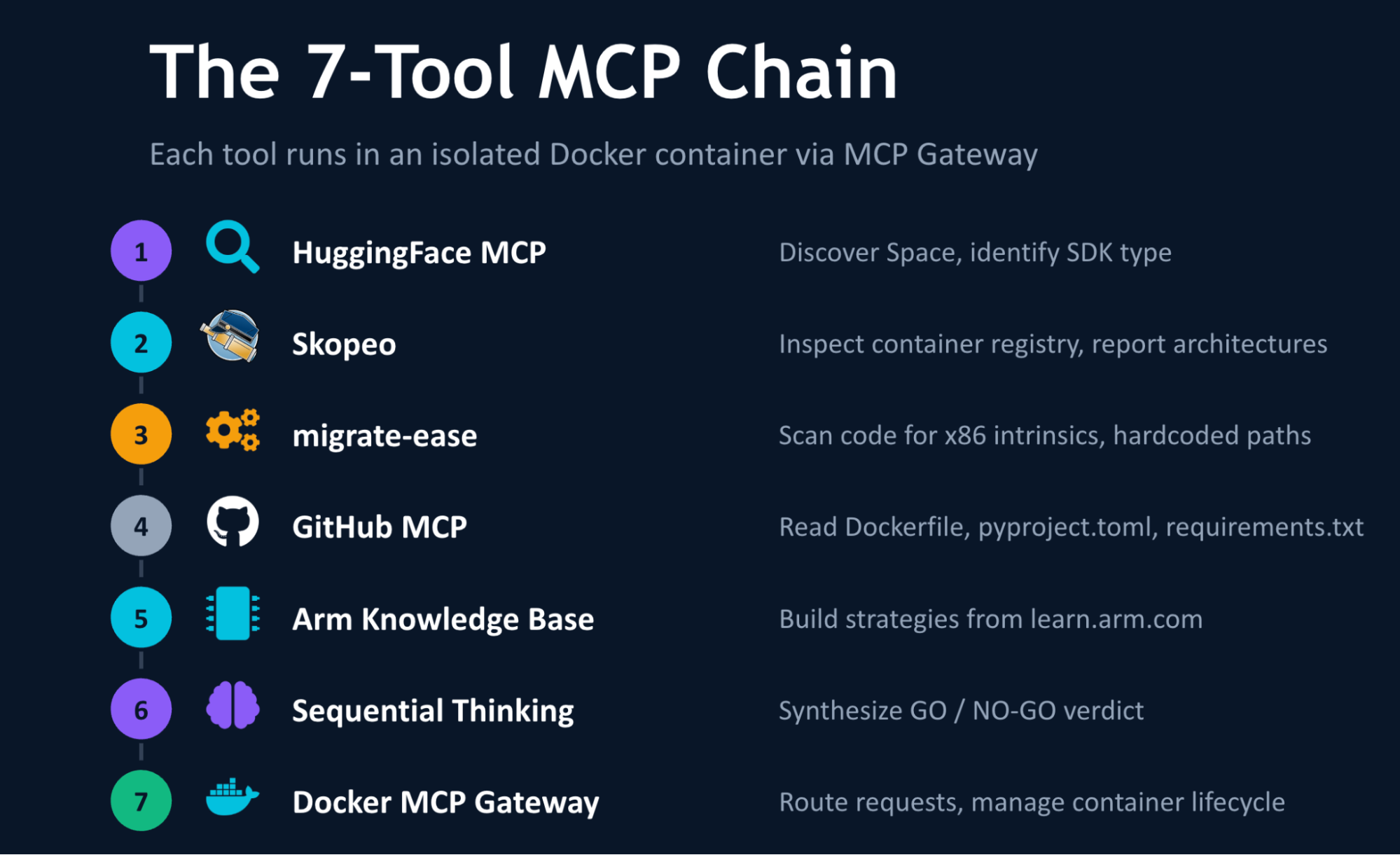

7-ツールMCPチェーン

Docker MCP Toolkit は安全なMCPゲートウェイを通じて解析をオーケストレーションします。各ツールは独立したDockerコンテナ上で動作します。この連鎖の7つのツールは以下の通りです:

キャプション: 7-ツール MCP チェーンアーキテクチャ図

ツール:

- Hugging Face MCP – 空間を発見し、SDKタイプを特定する(Docker対Gradio)

- Skopeo (Arm MCP Server経由)– コンテナレジストリを検査し、サポートされているアーキテクチャを報告します

- migrate-ease (Arm MCP Server経由)– x86固有のイントニシック、ハードコーディングされたパス、アーチロックされたライブラリのソースコードをスキャンします

- GitHub MCP –

Dockerfile、pyproject.toml、requirements.txtリポジトリより - Armナレッジベース (Arm MCPサーバー経由)– ビルド戦略や最適化ガイドの learn.arm.com 検索

- シーケンシャル・シンキング – 調査結果をまとめて構造化された移行の結論を導きます

- Docker MCP Gateway – リクエストのルーティング、コンテナライフサイクルの管理

この時点で自然な疑問は、Arm64 用にDockerイメージを単純に再構築して終わらせることができるかどうか、ということです。多くのアプリケーションでは可能です。しかし、再建が実際に成功するかどうかを事前に知るのは別の問題です。あなたのDockerファイルは、Arm64 ビルドを公開しないベースイメージに依存しているかもしれません。あなたのPython依存関係にはAarch64 ホイールがないかもしれません。あなたのコードはx個のシステムコール86使うかもしれません。MCPチェーンは、うまくいかないビルドに時間を投資する前にこれらすべてを自動的にチェックします。

Docker MCP ToolkitでVisual Studio Codeを設定する

前提 条件

開始する前に、次のものがあることを確認してください。

- 最低 8 GBのRAM(推奨16GB)のマシン

- 最新のDocker Desktopリリース

- GitHub Copilot拡張機能を使ったVS Code

- 個人アクセストークン付きのGitHubアカウント

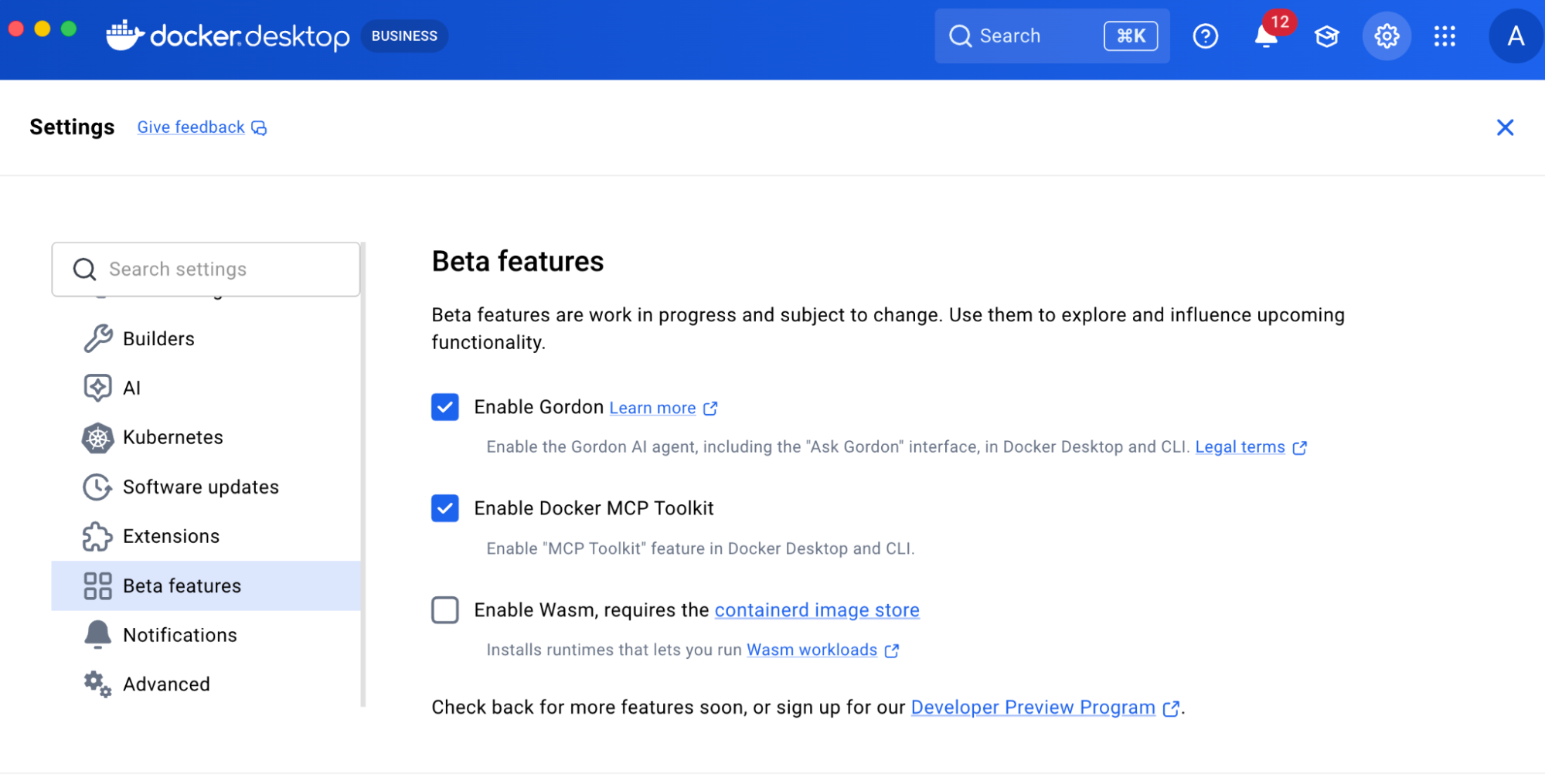

ステップ 1。Docker MCP Toolkitを有効にする

Dockerデスクトップを開き、設定からMCP Toolkitを有効にしてください。

以下を可能にする方法:

- Docker Desktop を開く

- ベータ機能>設定へ

キャプション:Docker Desktop 下のDocker MCP Toolkitを有効にする

- Toggle Docker MCP Toolkit ON

- 「応募」をクリックします

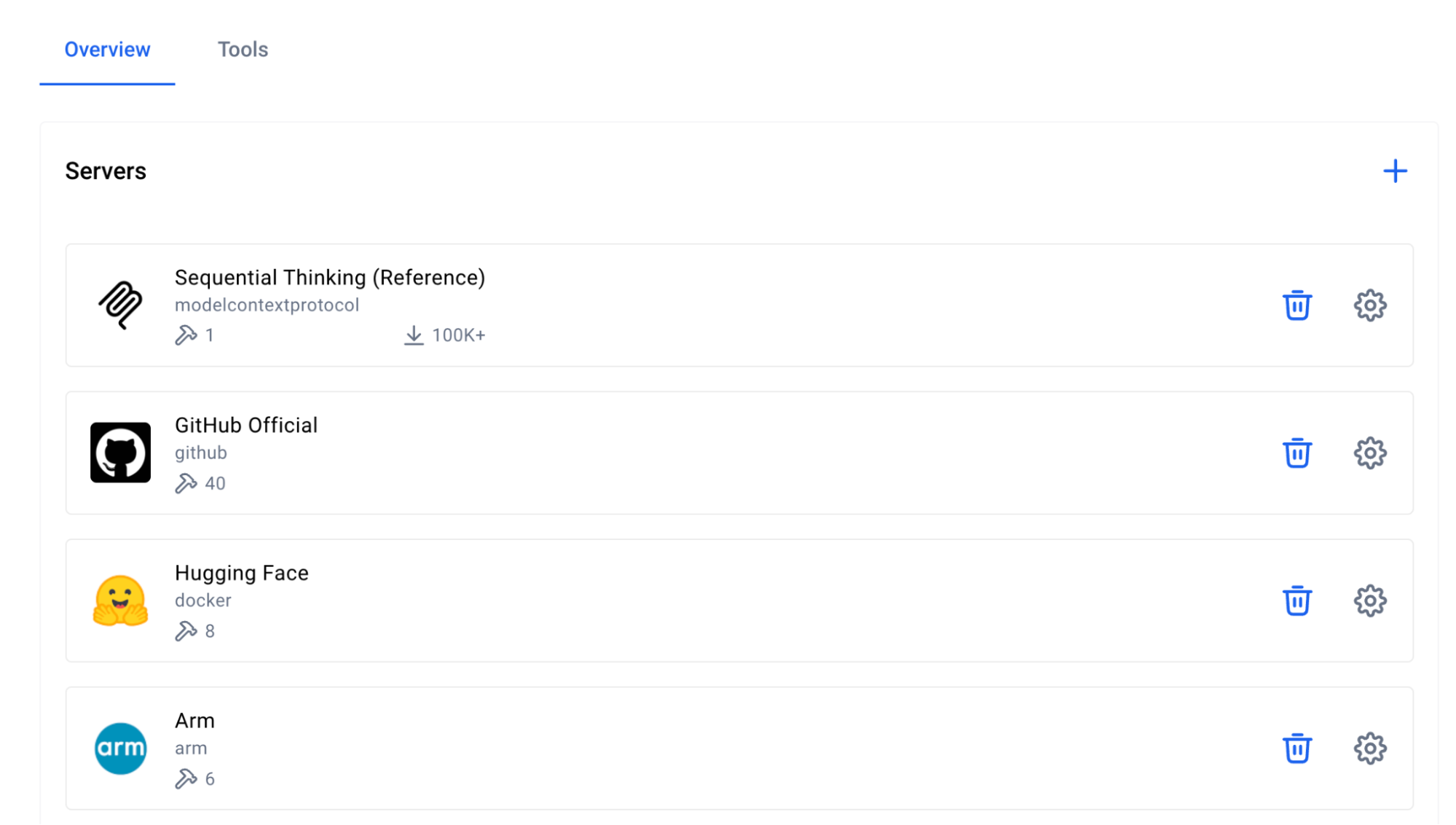

ステップ 2。カタログから必要なMCPサーバーを追加する

カタログから以下の4台のMCPサーバーを追加します。Docker Desktop MCP Toolkitの「Catalog」を選択するか、以下のリンクから見つけることができます:

- Arm MCP Server – アーキテクチャ解析、

migrate-easeスキャン、skopeo検査、Armナレッジベース - GitHub MCP Server – リポジトリ解析、コード読み取り、プルリクエスト作成

- シーケンシャルシンキングMCPサーバー – 複雑な問題の分解と計画

- Hugging Face MCPサーバー – 宇宙探索とメタデータ取得

キャプション:Docker MCPカタログでArm MCPサーバーを検索

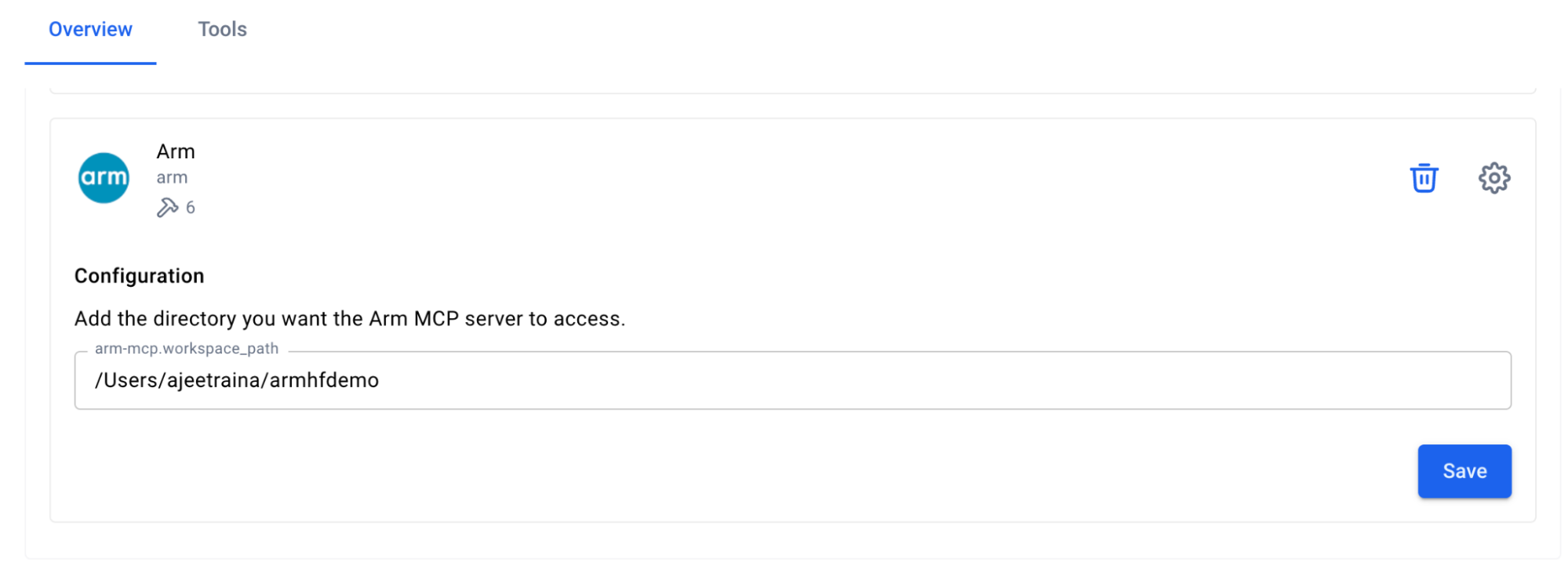

ステップ 3。サーバーの設定

- Arm MCPサーバーの設定

移行イージースキャンおよびMCAツールでローカルコードにアクセスするには、Arm MCPサーバーがローカルコードを指すディレクトリを設定する必要があります。

キャプション:Arm MCPサーバーの設定

「保存」をクリックすると、Arm MCPサーバーがコードの探し場所を把握してくれます。将来的に別のディレクトリへのアクセスを許可したい場合は、このパスを変更する必要があります。

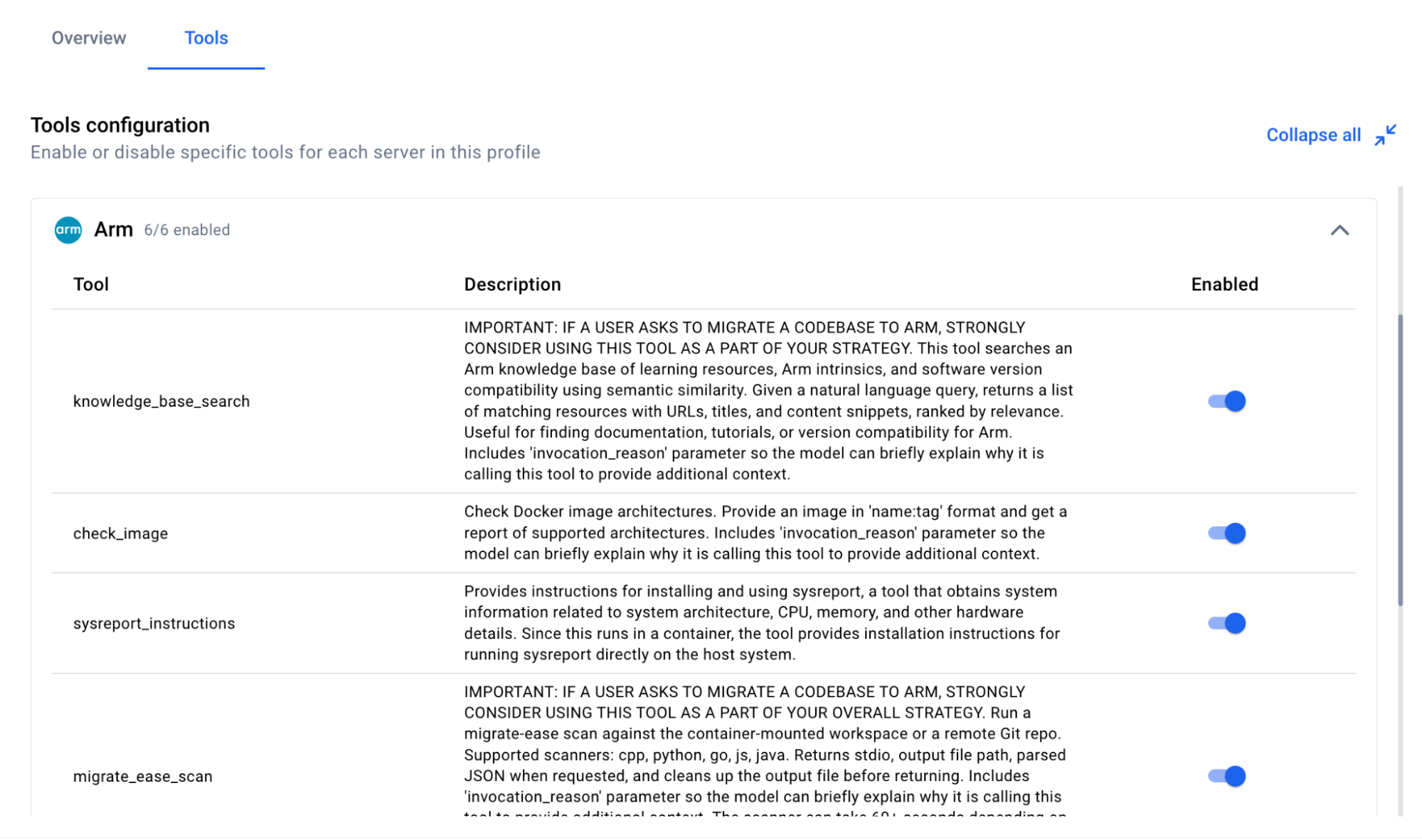

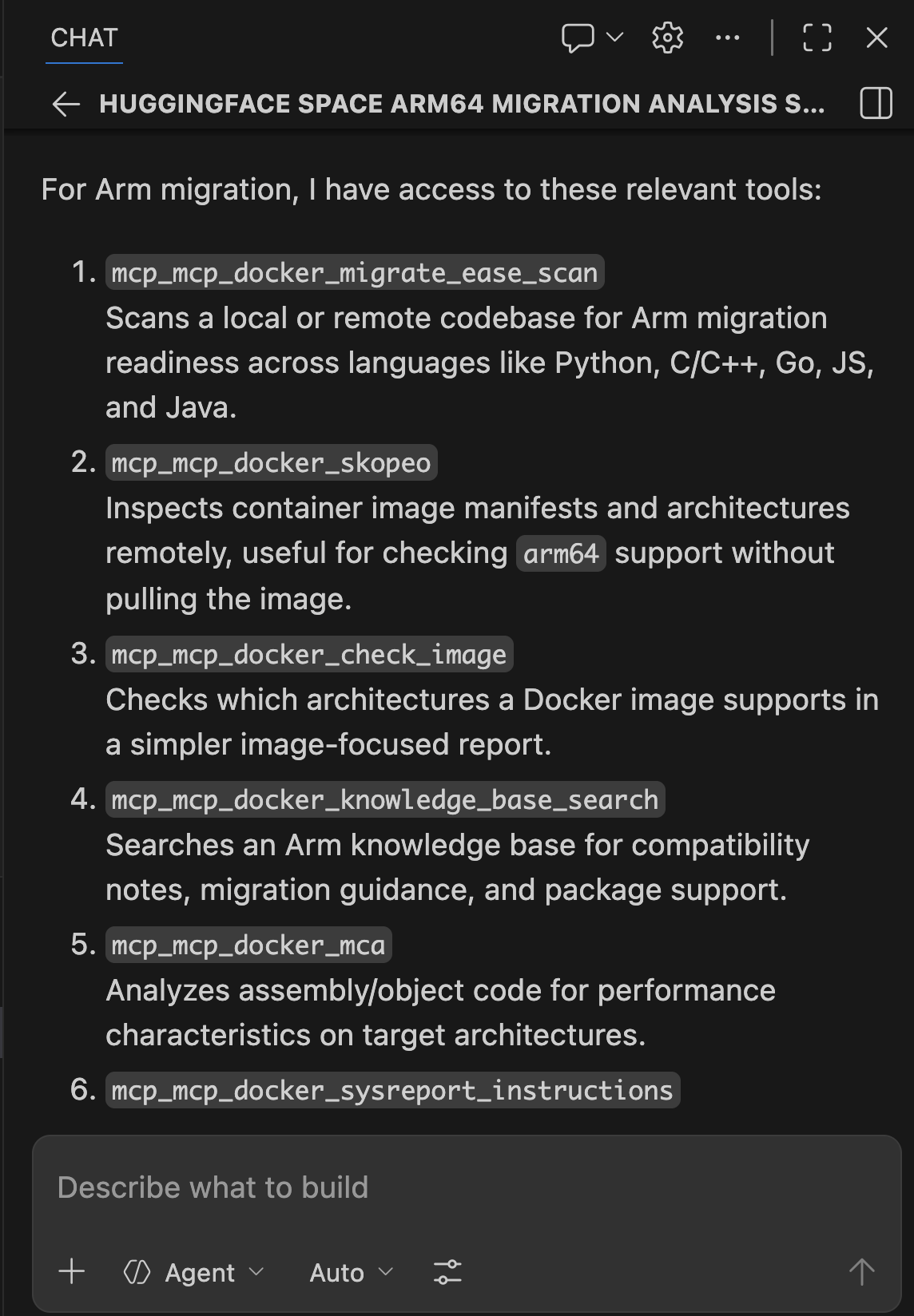

利用可能なアーム移行ツール

Arm MCP Serverで利用可能な6つのMCPツールすべてを見るには、ツールをクリックしてください:

キャプション:Arm MCPサーバーが提供するMCPツール一覧

knowledge_base_search– Arm学習リソース、内在文書、ソフトウェア互換性の意味検索migrate_ease_scan– C++、Python、Go、JavaScript、Javaに対応したコードスキャナー(Arm互換性解析)check_image– Dockerイメージアーキテクチャ検証(イメージがArm64をサポートしているか確認)skopeo– ダウンロード不要の遠隔コンテナ画像検査mca– アセンブリ性能分析およびIPC予測のためのマシンコードアナライザsysreport_instructions– システムアーキテクチャ情報収集

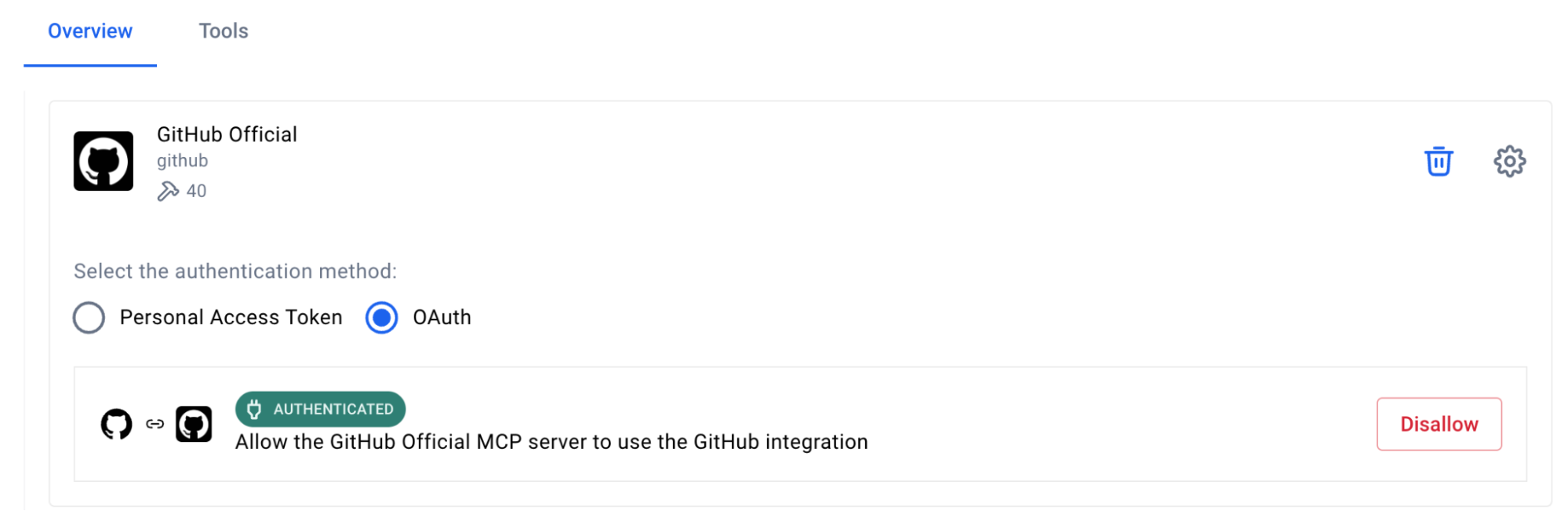

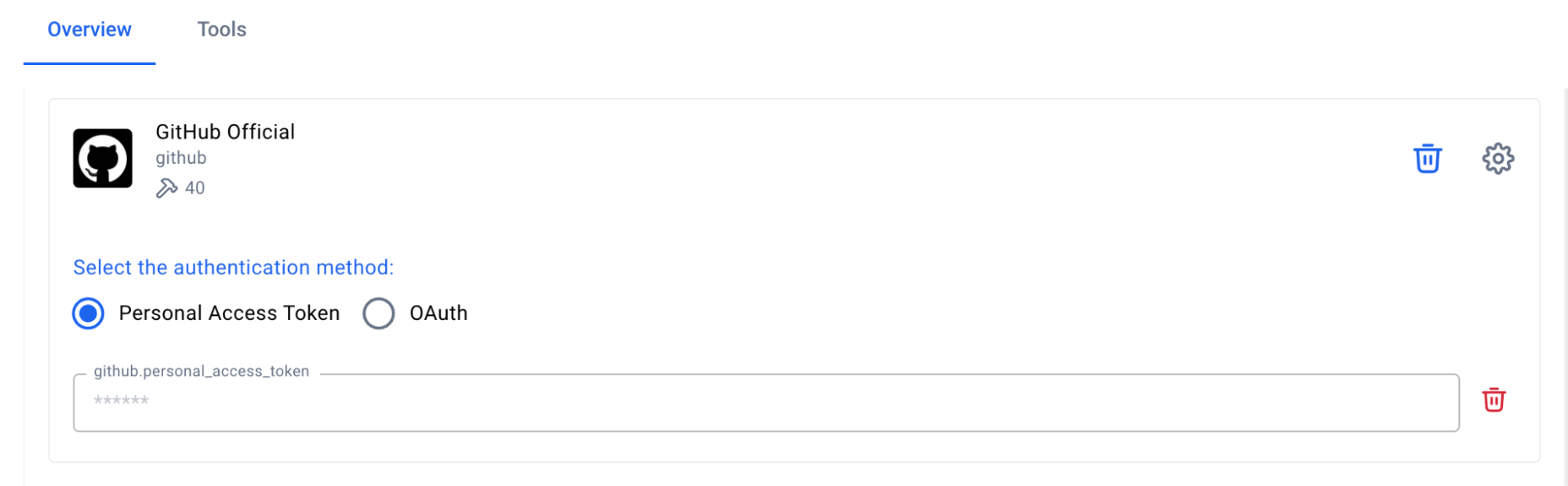

- GitHub MCPサーバーの設定

GitHub MCP Serverは、GitHub Copilotがリポジトリの読み取り、プルリクエストの作成、課題管理、変更のコミットを可能にします。

キャプション:GitHub公式MCPサーバーの設定手順

認証の設定:

- GitHub officialを選択してください

- 希望する認証方法を選びましょう

- パーソナルアクセストークンについては、GitHub>設定>開発者設定から取得してください

キャプション:GitHub MCPサーバーでのパーソナルアクセストークンの設定

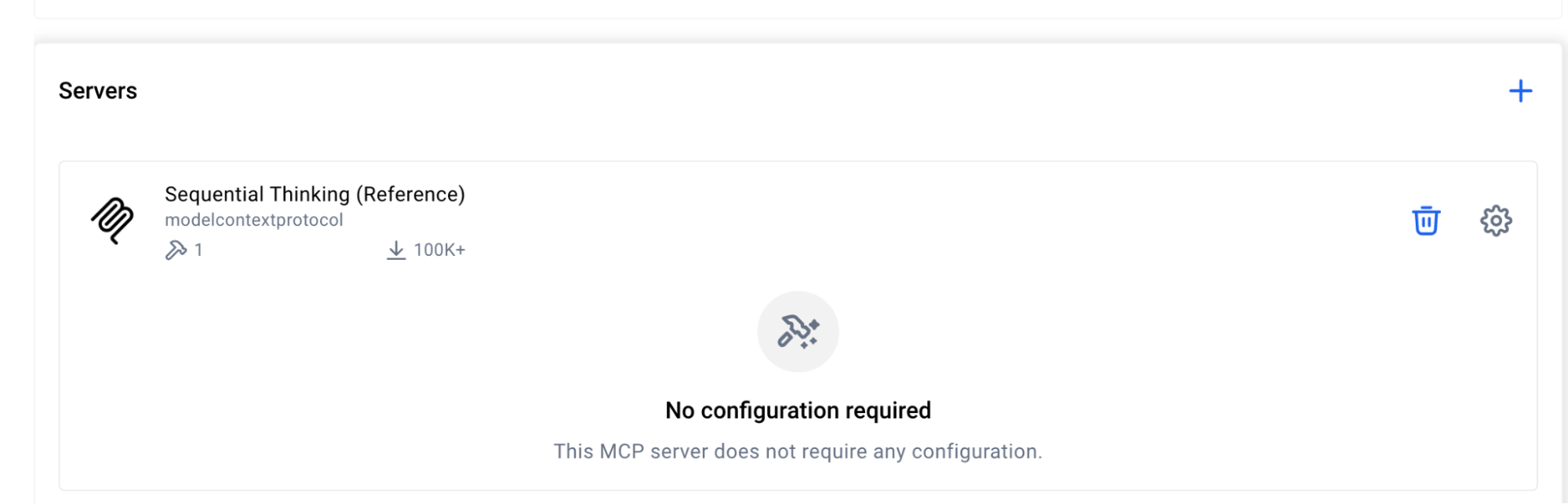

- シーケンシャルシンキングMCPサーバーの設定

- 「シーケンシャルシンキング」をクリックしてください

- 設定は不要です

キャプション:シーケンシャルMCPサーバーは設定不要

このサーバーはGitHub Copilotが複雑な移行決定を論理的なステップに分解するのに役立ちます。

- Hugging Face MCPサーバーの設定

Hugging Face MCPサーバーは、Hugging Face Hubから直接スペースのメタデータ、モデル情報、リポジトリ内容へのアクセスを提供します。

- 「ハグフェイス」をクリックしてください

- 公共スペースの追加設定は不要です

- プライベートスペースの場合は、HuggingFaceのAPIトークンを追加してください

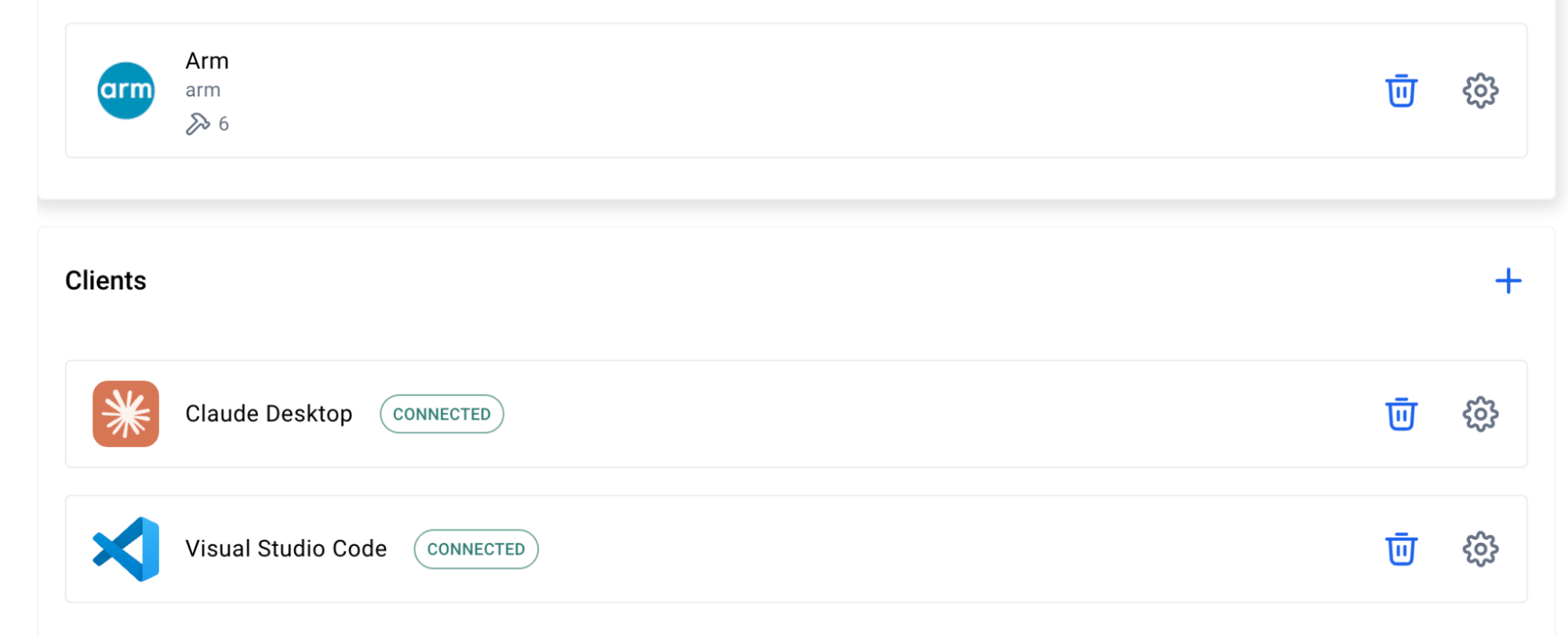

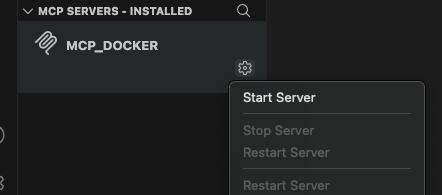

ステップ 4。VSコードにサーバーを追加する

Docker MCP Toolkitを使えば、VS Codeのようなクライアント向けにMCPサーバーを非常に簡単に設定できます。

設定するには、「クライアント」をクリックして下にスクロールしてVisual Studio Codeへ行ってください。「接続」ボタンをクリックしてください:

キャプション:Visual Studio CodeをMCPクライアントとして設定する

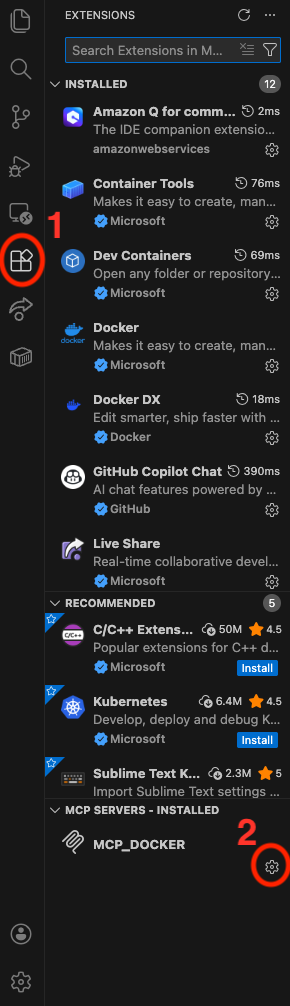

次にVS Codeを開き、左のツールバーにある「拡張機能」アイコンをクリックしてください:

キャプション:VS Code拡張機能でのMCP_DOCKER設定

MCP_DOCKERのギアをクリックし、「サーバー開始」をクリックしてください:

キャプション:VS CodeでMCPサーバーを起動

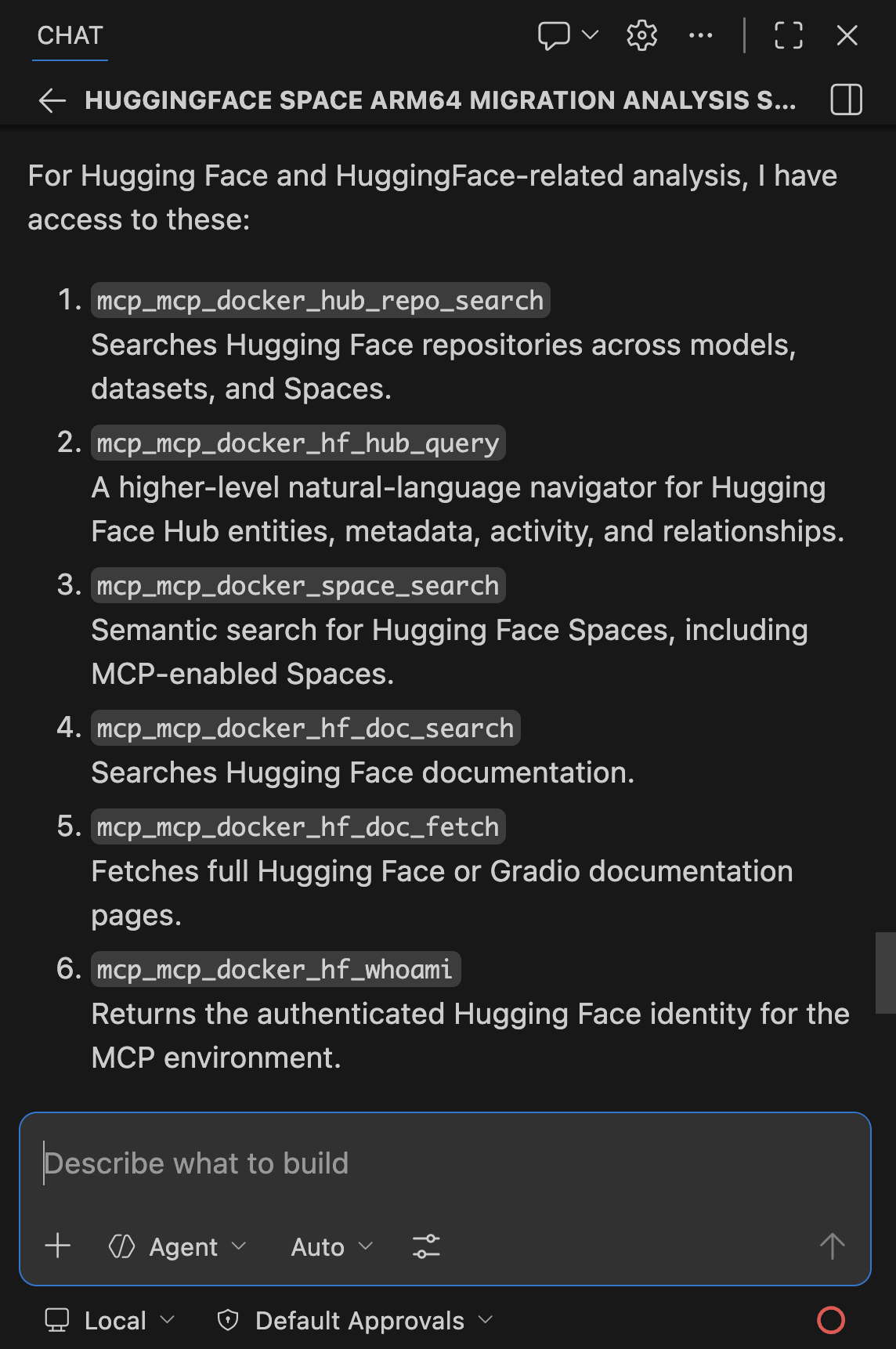

ステップ 5。接続確認

GitHub Copilot ChatをVS Codeで開いて質問してください:

What Arm migration and Hugging Face tools do you have access to?

4つのサーバーすべてのツールがリストされているはずです。彼らを見かけたら、接続は正常です。ハグングフェイススペースをスキャンしてみましょう。

キャプション:GitHub Copilotで遊ぶ

実世界デモ:ACE-Step v1のスキャン。5

GitHub CopilotをDocker MCP Toolkitに接続したところで、Armの準備状況を64 把握するために実際のHugging Face Spaceをスキャンし、ローカルで実行しようとした際に遭遇した正確なArm64 ブロッカーを見つけてみましょう。

- ターゲット: ACE-ステップ v1。5― 3。5Bパラメータの音楽生成モデル

- スキャンまでの時間:15分

- インフラコスト: $0 (すべてのツールはDockerコンテナ上でローカルで動作)

ワークフロー

Docker MCP Toolkitは、リクエストを専門ツールにルーティングする安全なMCPゲートウェイを通じてスキャンをオーケストレーションします。Arm MCPサーバーは画像を検査しコードをスキャンし、Hugging Face MCPはスペースを発見し、GitHub MCPはリポジトリを読み取り、Sequential Thinkingが結果を総合します。

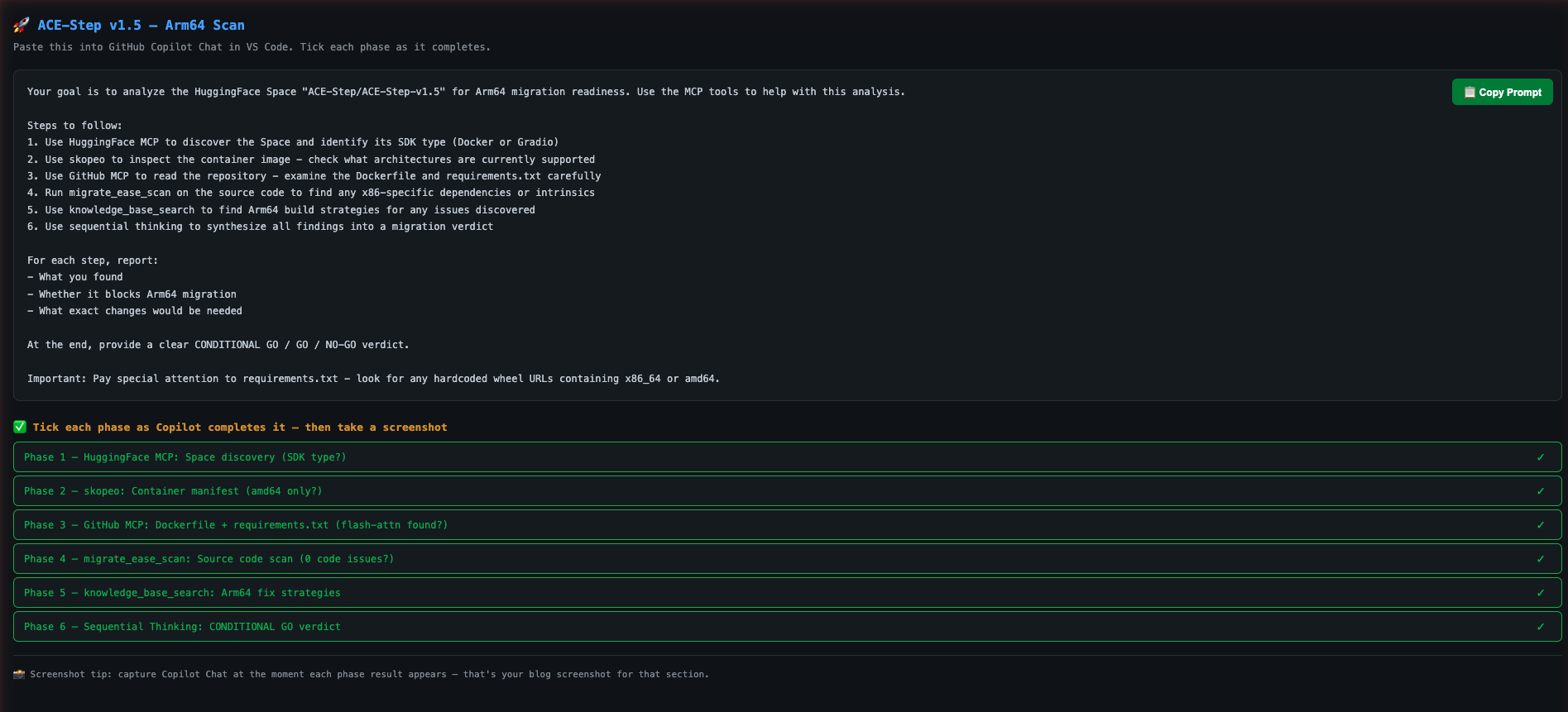

ステップ 1。GitHub Copilot スキャンの指示を出す

VS Codeでプロジェクトを開きます。GitHub Copilot Chatで、このプロンプトを貼り付けてください:

Your goal is to analyze the Hugging Face Space "ACE-Step/ACE-Step-v1.5" for Arm64 migration readiness. Use the MCP tools to help with this analysis.

Steps to follow:

1. Use Hugging Face MCP to discover the Space and identify its SDK type (Docker or Gradio)

2. Use skopeo to inspect the container image - check what architectures are currently supported

3. Use GitHub MCP to read the repository - examine pyproject.toml, Dockerfile, and requirements

4. Run migrate_ease_scan on the source code to find any x86-specific dependencies or intrinsics

5. Use knowledge_base_search to find Arm64 build strategies for any issues discovered

6. Use sequential thinking to synthesize all findings into a migration verdict

At the end, provide a clear GO / NO-GO verdict with a summary of required changes.

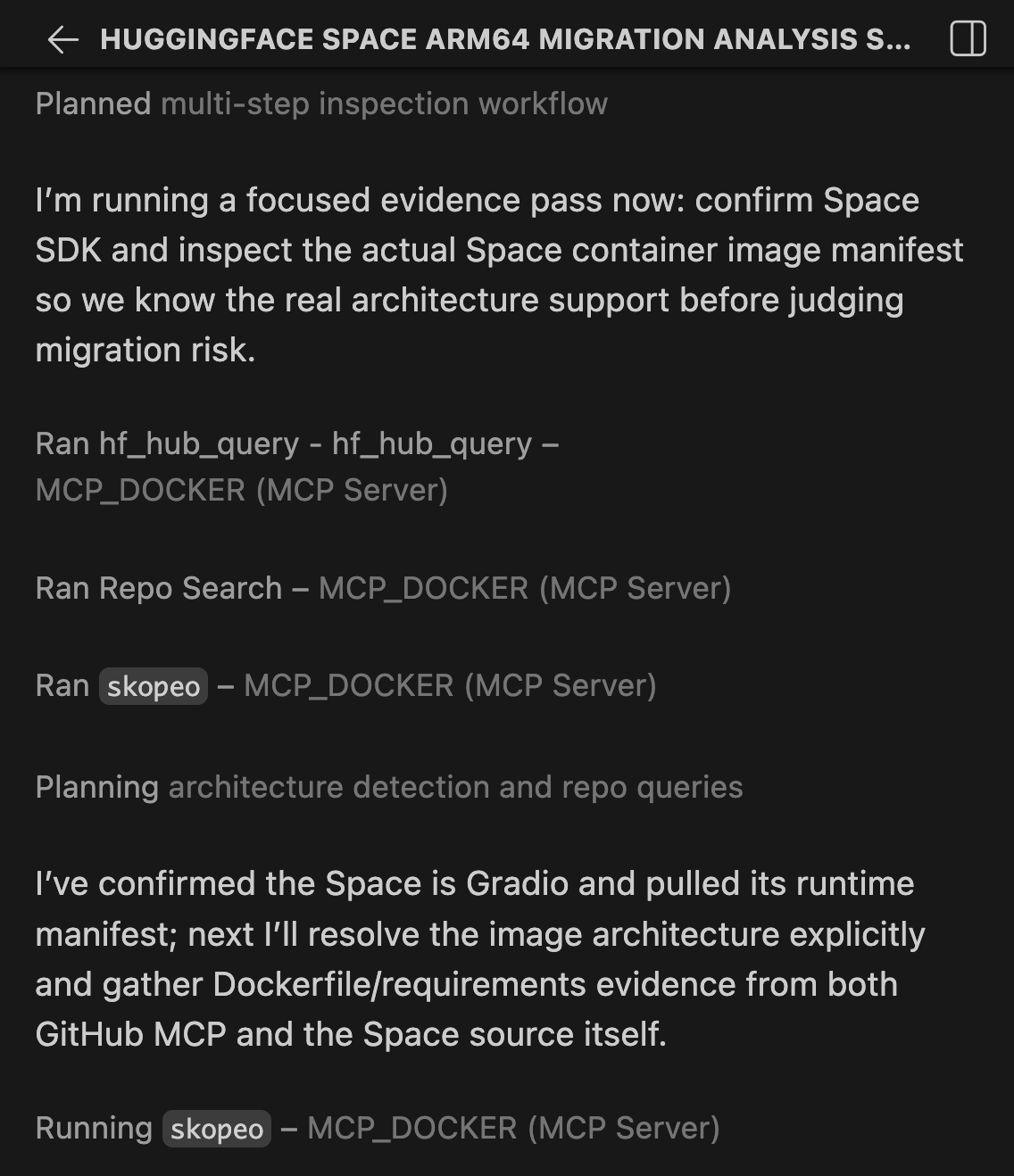

ステップ 2。Watch Docker MCP Toolkit Execute

GitHub CopilotはDocker MCP Toolkitを使ってスキャンをオーケストレーションします。こういうことが起こる:

フェーズ 1:宇宙発見

GitHub CopilotはまずHugging Face MCPサーバーに問い合わせてSpaceメタデータを取得します。

キャプション:GitHub CopilotはHugging Face MCPを使ってスペースを発見し、そのSDKタイプを特定しています。

ツールはACE-Step v1を返します。5Docker SDK を使用しているため、Hugging FaceはGradioアプリではなく、事前に構築されたコンテナイメージとして提供しています。これは非常に重要です。Docker SDK Spacesには分析・再構築可能なDockerファイルがありますが、Gradio SDK SpacesはHugging Faceのインフラによって構築されており、私たちが制御できません。

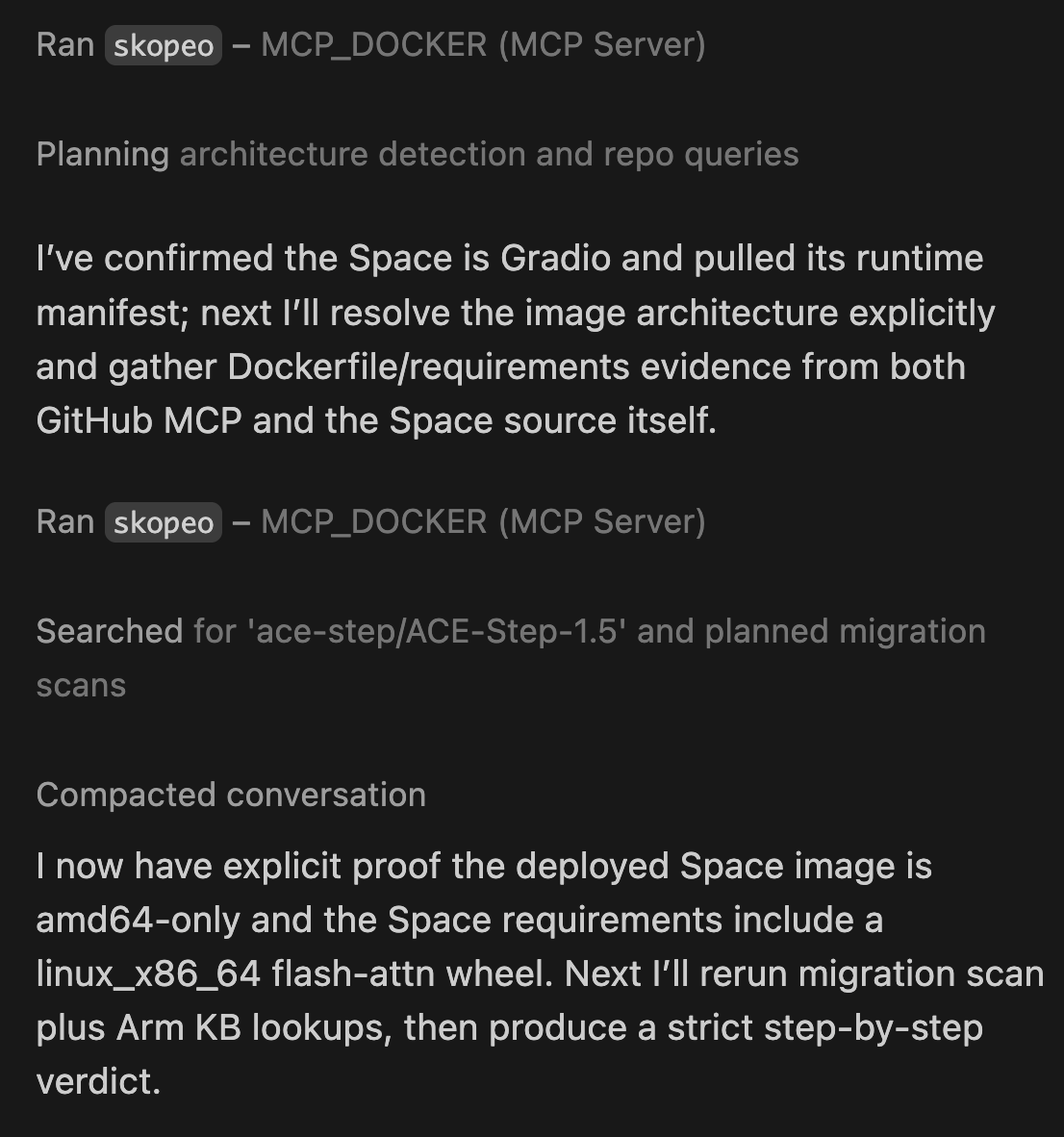

フェーズ 2:コンテナ画像検査

次に、CopilotはArm MCP Serverの skopeo ツールを使ってコンテナイメージをダウンロードせずに検査します。

キャプション:skopeoツールによると、コンテナイメージにはArm64 ビルドが存在しないことが報告されています。コンテナはArmハードウェアで起動しません。

結果として、マニフェストにはLinux/AMD64のみが含まれています。アーム64 ビルドは存在しません。これは、コンテナがARMハードウェアで故障する最初の具体的なデータポイントです。しかし、これが全てではありません。

フェーズ 3:ソースコード分析

CopilotはGitHub MCPを使ってリポジトリのキーファイルを読み込みます。こちらが Spaceの実際のDockerファイル です:

FROM python:3.11-slim

ENV PYTHONDONTWRITEBYTECODE=1 \

PYTHONUNBUFFERED=1 \

DEBIAN_FRONTEND=noninteractive \

TORCHAUDIO_USE_TORCHCODEC=0

RUN apt-get update && \

apt-get install -y --no-install-recommends git libsndfile1 build-essential && \

apt-get install -y ffmpeg libavcodec-dev libavformat-dev libavutil-dev libswresample-dev && \

rm -rf /var/lib/apt/lists/*

RUN useradd -m -u 1000 user

RUN mkdir -p /data && chown user:user /data && chmod 755 /data

ENV HOME=/home/user \

PATH=/home/user/.local/bin:$PATH \

GRADIO_SERVER_NAME=0.0.0.0 \

GRADIO_SERVER_PORT=7860

WORKDIR $HOME/app

COPY --chown=user:user requirements.txt .

COPY --chown=user:user acestep/third_parts/nano-vllm ./acestep/third_parts/nano-vllm

USER user

RUN pip install --no-cache-dir --user -r requirements.txt

RUN pip install --no-deps ./acestep/third_parts/nano-vllm

COPY --chown=user:user . .

EXPOSE 7860

CMD ["python", "app.py"]

Dockerfile自体はきれいに見えます:

- パイソン:3。11-slimはすでにARM64を含むマルチアーチビルドを公開しています

- -mavx2なし -march=x86-64 コンパイラフラグなし

- build-essential、ffmpeg、libsndfile1 はすべてDebianのアーム64 リポジトリで利用可能です

しかし、本当の問題は requirements.txtにあります。私がACE-Stepをローカルでインストールしようとしたときに遭遇したのは以下の通りです:

# nano-vllm dependencies

triton>=3.0.0; sys_platform != 'win32'

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/

download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl

; sys_platform == 'linux' and python_version == '3.11'

即座に阻む原因が2つあります:

flash-attnはハードコードされたlinux_x86_64ホイールURLにピン留めされています。Aarch64システムでは、pipがこのホイールをダウンロードすると即座に「このプラットフォームではサポートホイールではありません」と拒否します。まさに私がエラーに遭遇しました。triton>=3.0.0Linux版PyPIにはAarch64 ホイールがありません。Armのハードウェアでは失敗します。

これらはコードの問題ではありません。Pythonのソースコードはアーキテクチャに依存しません。解決策は依存関係宣言にあります。

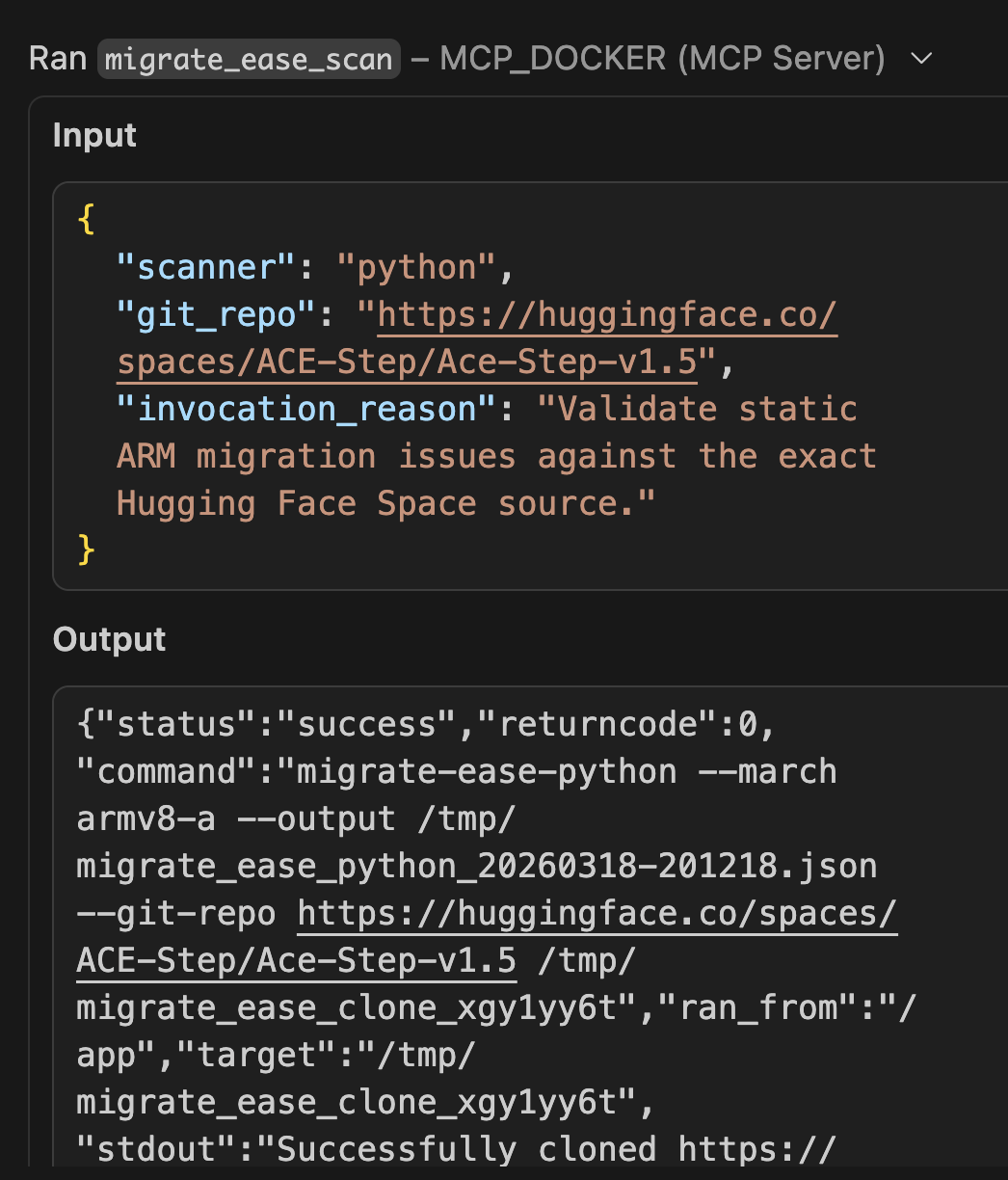

フェーズ 4:アーキテクチャ互換性スキャン

Copilotはコードベース上でPythonスキャナーを使って migrate_ease_scan ツールを動かします。

キャプション:migrate_ease_scanツールはPythonのソースコードを分析し、特定の依存関係を0x個86特定しています。イントニシックもハードコーディングパスもアーキテクチャロックライブラリもありません。

アプリケーションのソースコード自体はアーキテクチャ 0 問題を返します — x86 の内在要素がなく、プラットフォーム固有のシステムコールもありません。しかし、スキャンでは依存関係のマニフェストも検出されます。requirements.txtにブロッカーが2人いる:

|

依存関係 |

子女 |

アーム64 フィックス |

|---|---|---|

|

Flash-Attn(Linuxホイール) |

ハードコードlinux_x86_64 URL |

フラッシュアタッチメント 2を使いましょう。7+ PyPI経由 — aarch64 wheelsをネイティブに公開 |

|

トリトン>=3。0。0 |

Linux用のAarch64 PyPIホイールはありません |

アーチ64 で除外するか、トリトン・ナイトリーアーチ64 ビルドしてください |

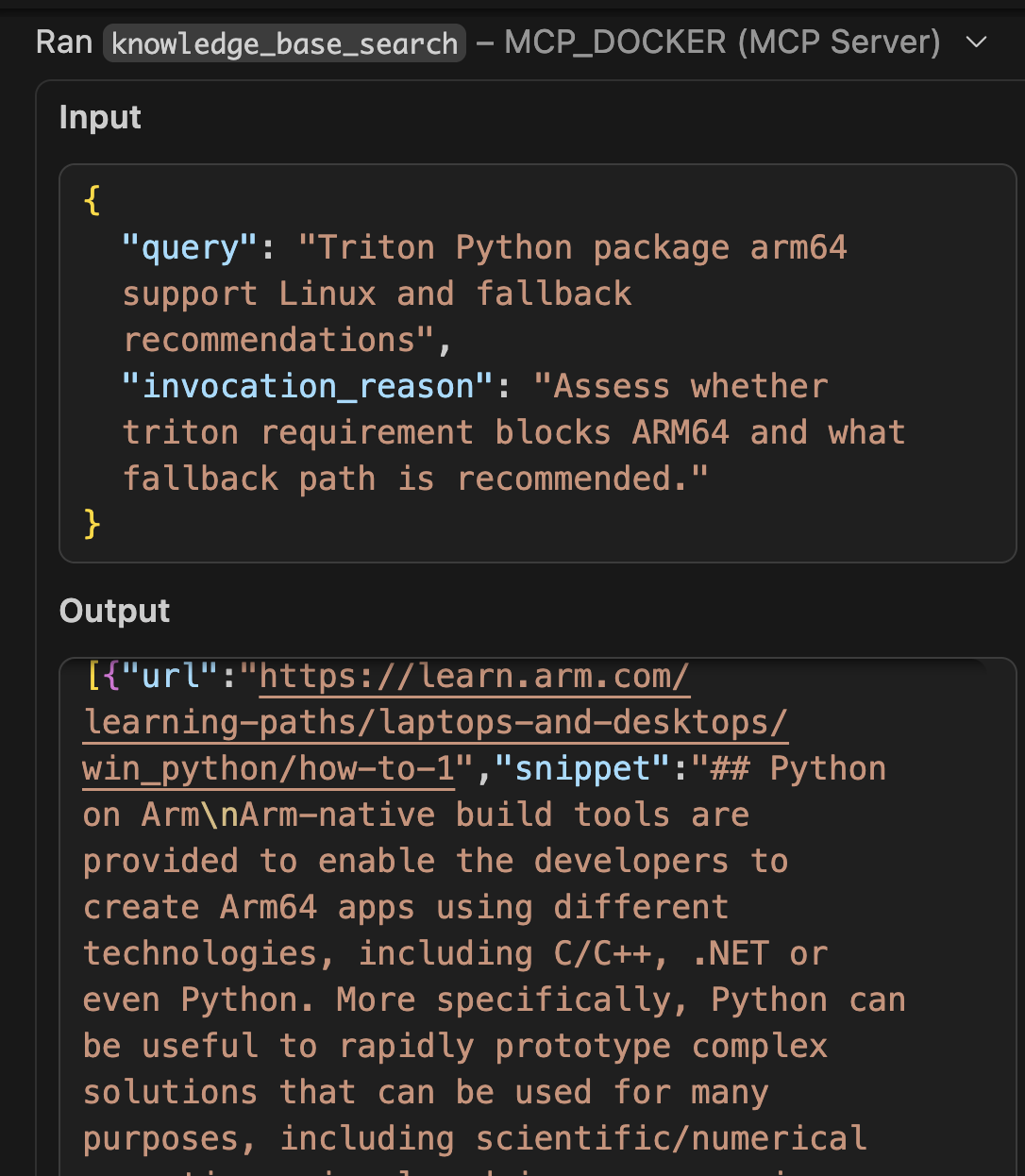

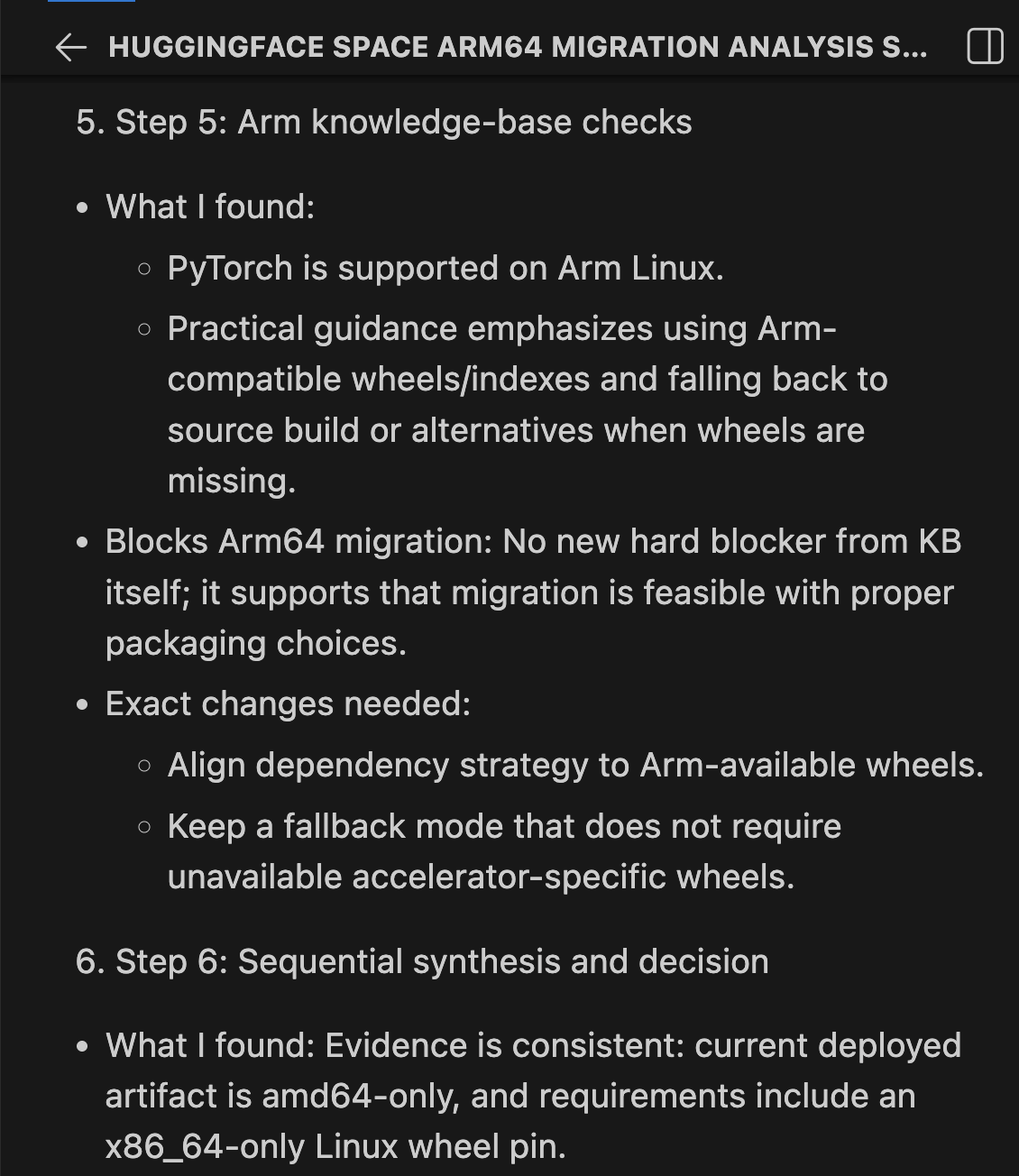

フェーズ 5:Armナレッジベースの検索

Copilotは発見された問題の解決策をArm MCPサーバーのナレッジベースに問い合わせます。

キャプション:GitHub Copilotはknowledge_base_searchツールを使って learn.arm.com のDocker buildxマルチアーチ戦略を見つけています。

ナレッジベースは以下の文書を返します:

- Flash-Attn Aarch64 ホイールの入手可能性はバージョン 2から提供されています。7+

- GravitonおよびApple Siliconの最適化ガイド64 PyTorch Arm

- CUDAのベストプラクティス 13。064 年(Jetson Thor / DGX Spark)

- Arm上のCPU推論パスにおけるtritonの代替

フェーズ 6:統合と結論

シーケンシャル・シンキングは、すべての調査結果をまとめて構造化された結論を導きます。

|

チェック |

result |

ブロック? |

|---|---|---|

|

コンテナマニフェスト |

AMD64 のみ |

はい、再構築が必要です |

|

ベース画像Python:3。11-スリム |

マルチアーチ(アーム64 あり) |

いいえ |

|

システムパッケージ(ffmpeg、libsndfile1) |

Debianのアーム64で利用可能です |

いいえ |

|

トーチ==2。9.1 |

アーチ64 ホイールズ出版 |

いいえ |

|

フラッシュ対応のLinuxホイール |

ハードコードlinux_x86_64 URL |

はい、ARM64 URLを添えて追加してください |

|

トリトン>=3。0。0 |

Aarch64 ホイールは 3から入手可能です。5。0+ |

いいえ、自動的に解決します |

|

ソースコード(migrate-ease) |

0 アーキテクチャの問題点 |

いいえ |

|

Dockerfileにおけるコンパイラフラグ |

特定のX86はない |

いいえ |

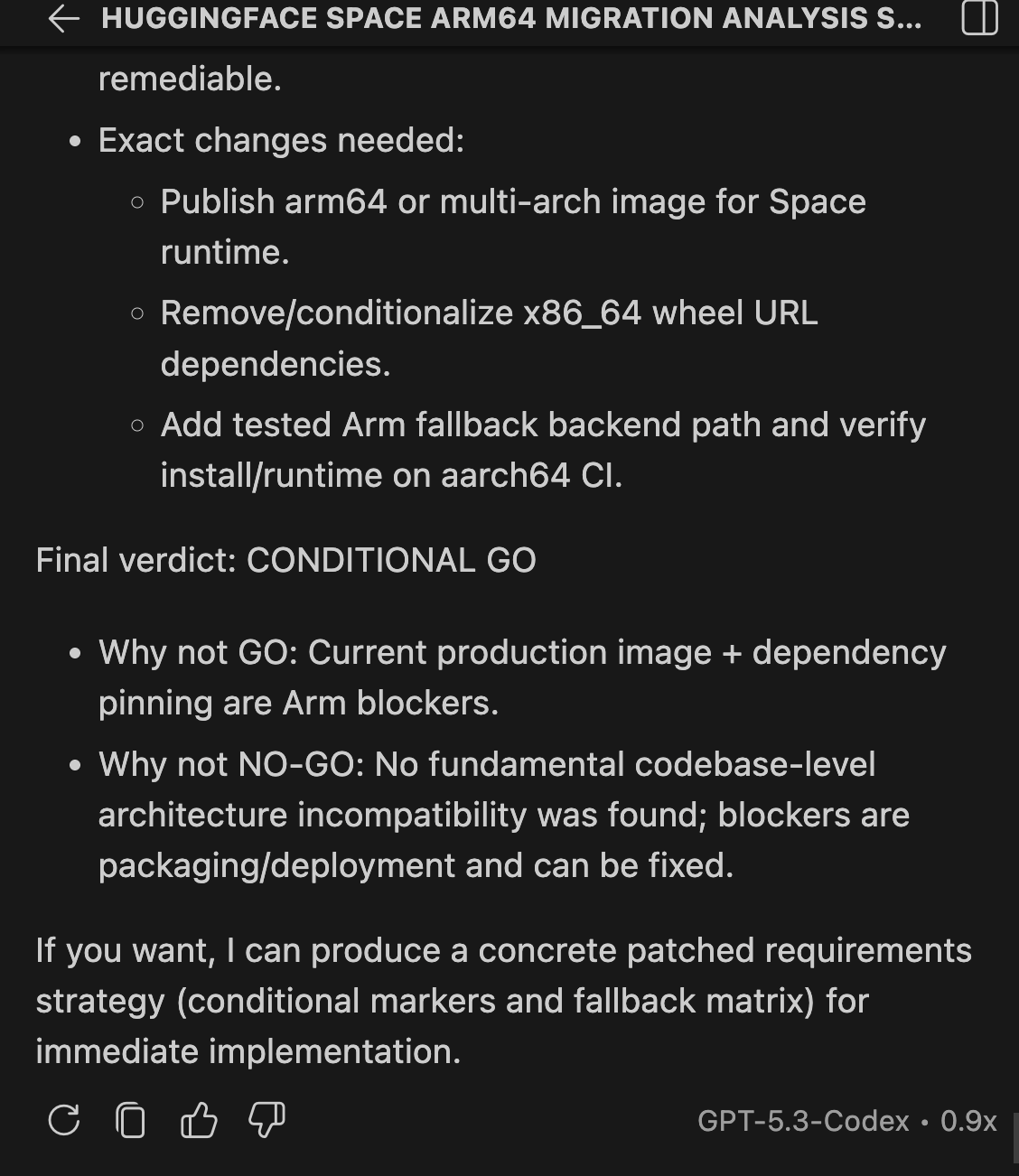

結論:条件付きで実行。コードの変更はゼロです。Dockerfileの変更はゼロです。依存関係の修正が必要です。

以下がrequirements.txtに必要な正確な変更点です:

# BEFORE — only x86_64

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_aarch64.whl ; sys_platform == 'linux' and python_version == '3.11' and platform_machine == 'aarch64'

# AFTER — add arm64 line alongside x86_64

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_aarch64.whl ; sys_platform == 'linux' and python_version == '3.11' and platform_machine == 'aarch64'

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl ; sys_platform == 'linux' and python_version == '3.11' and platform_machine != 'aarch64'

# triton — no change needed, 3.5.0+ has aarch64 wheels, resolves automatically

triton>=3.0.0; sys_platform != 'win32'

これら2つの修正の後、ビルドコマンドは次のようになります:

docker buildx build --platform linux/arm64 -t ace-step:arm64 .

この単一のコマンドで3つの展開経路が解放されます:

- NVIDIA Arm64 — Jetson Thor、DGX Spark(64 + CUDA 13.0)

- Cloud Arm64 — AWS Graviton、Azure Cobalt、Google Axion (20-40% コスト削減)

- Apple Silicon — M1- M4 MPS加速付きMac(ローカル推論、クラウドコスト0 ドル)

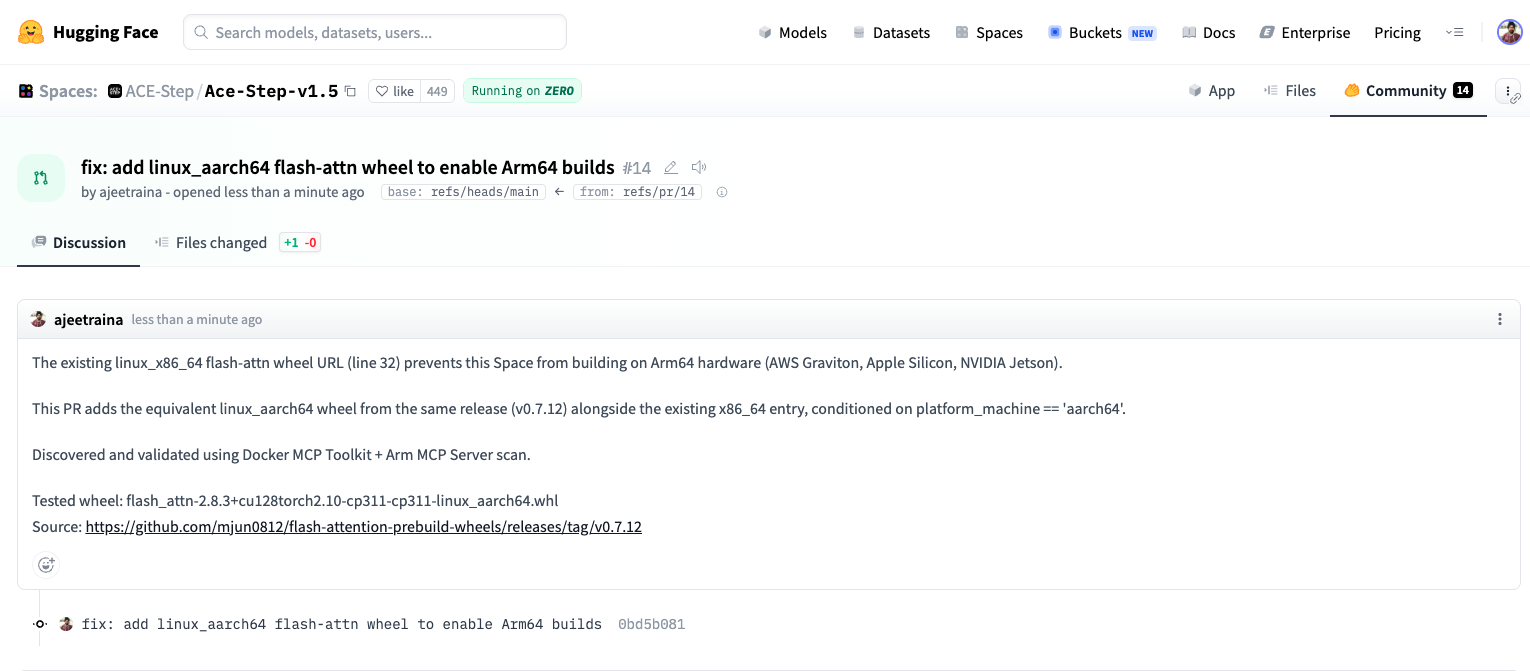

フェーズ 7:プルリクエストの作成

スキャン完了後、CopilotはGitHub MCPを使って修正提案を行います。唯一のブロッカーはrequirements.txtのライン32にハードコードされたlinux_x86_64ホイールURLなので、変更は外科的で、一行追加、何も削除されません。

修正は、同じリリースの相当 linux_aarch64 ホイールを既存の x86_64 エントリと並べて追加し、条件付け platform_machine == 'aarch64':

# BEFORE — only x86_64, fails silently on Arm

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/

download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl

; sys_platform == 'linux' and python_version == '3.11'

# AFTER — add arm64 line alongside, conditioned by platform_machine

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/

download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_x86_64.whl

; sys_platform == 'linux' and python_version == '3.11'

flash-attn @ https://github.com/mjun0812/flash-attention-prebuild-wheels/releases/

download/v0.7.12/flash_attn-2.8.3+cu128torch2.10-cp311-cp311-linux_aarch64.whl

; sys_platform == 'linux' and python_version == '3.11' and platform_machine == 'aarch64'

キャプション:PR #14 on Hugging Face – 合流準備完了

重要な洞察は、アップストリームのメンテナがすでに同じリリースでアーム64 ホイールを公開していることです。修正は再構築やコード変更ではなく、すでに存在するアーティファクトを参照する一行を追加するだけでした。MCPチェーンが 15 分で見つけた。これがなければ、この点のエラーに遭遇した開発者は何時間もかけて追跡しなければなりません。

PR: https://huggingface.co/spaces/ACE-Step/Ace-Step-v1。5/ディスカッション/14

ArmなしのMCPと、Arm MCPと共に

Arm MCP ServerをDocker MCP Toolkitに追加した際の変更点を明確にしましょう。

- ArmなしのMCP:GitHub CopilotにHugging Face SpaceでArm64 互換性を確認するよう依頼します。Copilotからの一般的なアドバイスは「ベースイメージがARM64をサポートしているか確認し」、「x86固有のコードを探す」「buildxで再構築を試してみて」といったものです。手動でDocker Hubを点検し、コードベースをgrepし、PyPIへの依存関係を一つずつ確認し、簡単には診断できないPIPインストールの失敗に遭遇します。フラッシュアタッチのURL問題だけでも1時間かかることがあります。

- Arm MCP + Docker MCP Toolkitについて:同じ質問をしますね。数分以内に、skopeoを使ってベースイメージを検証し、実際のコードベース上でmigrate_ease_scan動き、ハードコードされた linux_x86_ ホイールURLをフラグ付けrequirements.txt _64 ホイールのURLにフラグ付けします。クエリは正しい修正をknowledge_base_searchし、すべてのチェックが記録された構造化された条件付きGO判定を合成します。

実際の画像が検査されます。本物のコードはスキャンされます。実際の依存関係ファイルが分析されます。違いは、Docker MCP ToolkitはGitHub Copilotに実際のArm移行ツールへのアクセスを提供し、単なる一般的な知識だけでなく、

手動プロセスとMCPチェーンの違い

手作業のプロセス:

- Hugging Face Spaceリポジトリのクローン(10 分)

- アーキテクチャサポートのコンテナマニフェストをチェックする(5 分)

- pyproject.tomlとrequirements.txtを読み進めてください(20 分)

- PyPIですべての依存関係でArm64 wheelの可用性を確認してください(30 分)

- Dockerファイルのハードコードされたアーキテクチャの仮定を分析する(10 分)

- 必要なバージョンのCUDA/cuDNN Arm64 サポートについて調べてください(20 分)

- 調査結果と推奨変更点を書き留める(15 分)

合計: 2-3 Space

Docker MCP Toolkit を使って:

- GitHub Copilotにスキャン指示を渡してください(5 分)

- 移行レポートのレビュー(5 分)

- 変更を加えたPRを提出する(5 分)

合計:1スペースあたり 15 分

これが大規模に示唆すること

ACE-Stepは標準的なPython AIアプリケーションです:PyTorch、Gradio、pip依存関係、スリムなDockerファイルなどがあります。このパターンはHugging Face上のDocker SDKスペースの大部分をカバーしています。

これらのアプリのアーム64 ウォールは必ずしも見えるわけではありません。Dockerfileはきれいに見えます。ベース画像はアーム64をサポートしています。Pythonのコードには本質的な要素はありません。しかしrequirements.txtの中に埋もれているのは、linux_x86_64 バイナリを指すハードコーディングされたホイールURLで、実際にArmハードウェアでコンテナを実行しようとするまで誰も見つけられません。

これが80%の問題です。 Hugging FaceのDocker Spacesの80%はArm上で一度もテストされたことがありません。コードが動かないからではありません。しかし、誰も確認しなかったからです。MCPチェーンは、ピップエラーのデバッグにかかる午後の時間ではなく、 15 分で終わる体系的なチェックです。

これは実際のコストに影響を及ぼします。

- グラビトン推論は 20動作し、同じ負荷で40%安くなります。すべてのAMD64Spaceはその節約をそのまま残します。

- NVIDIA Physical AI(GR00T、LeRobot、Isaac)がJetson Thorに展開されます。開発者はHugging Faceでモデルを見つけますが、コンテナはターゲットハードウェアに組み込まれていません。

- Apple Siliconは開発者向けのノートパソコンとして最も一般的なものです。局所推論は反復処理が速くなり、クラウド料金がかかりません。

Docker MCP Toolkitが開発に与える変化

Docker MCP Toolkitは、開発者が専門知識や能力とどのように関わるかを変えます。新しいツールを学んだり、依存関係をインストールしたり、認証情報を管理する代わりに、開発者はAIアシスタントを一度接続すれば、すぐにコンテナ化された専門知識にアクセスできます。

その利点はハグフェイススキャンだけにとどまりません。

- 一貫性 — 同じツールチェーン 7、どのコンテナでも同じ構造化された分析が得られます

- セキュリティ — 各ツールは隔離されたDockerコンテナ上で動作し、ツールの干渉を防ぎます

- 再現性 — スキャンは環境を越えて同じように振る舞います

- コンポーザビリティ — エコシステムの進化に応じてツールを追加または交換する

- 発見可能性 — Docker MCP Catalog は適切なサーバーを見つけるのを簡単にします

最も重要なのは、開発者が既存のワークフローを維持していることです。VS Code。GitHub Copilot。行け。外部ツールやダッシュボードにコンテキスト切り替えもありません。

まとめ

あなたは今、Docker MCP Toolkit、Arm MCP Server、GitHub Copilotを使って、Arm64 準備のための本物のHugging Face Spaceをスキャンしました。ACE-Step対1で分かったこと。5 はHugging Face全体で見られるものを象徴しています。アーキテクチャに中立的なコード、すでにクリーンなDockerファイル、しかしハードコードされたx86_64 ホイールURLがrequirements.txt、Arm64 ビルドを静かに壊すものです。

MCPチェーンはこれを 15 分で表に出します。それがなければ、原因への明確な道筋のない点の誤りを直視することになります。

試してみる準備はできていますか?Docker Desktopを開き、MCPカタログを探索してください。まず はArm MCPサーバーから始め、 GitHub、Sequential Thinking、 Hugging Face MCPを追加してください。そのチェーンを扱っているHugging Face Spaceに向けて、何が返ってくるか確認してください。

詳細情報

- Docker は初めてですか? Docker Desktop をダウンロードする

- MCPカタログを探る: コンテナ化されたセキュリティ強化されたMCPサーバーを発見

- MCP Toolkitの始め方: 公式文書

- Arm MCPサーバー: 開発者ドキュメント

- ハグフェイスMCPサーバー: ハブドキュメント

- ACE-Step v1。5: ハグング・フェイス・スペース

- 移民PR: GitHubプルリクエスト