API に依存する AI の高価で遅い世界から逃れるための実践的なアプローチ

$20K の月間リアリティ チェック

顧客レビュー用のシンプルなセンチメント アナライザーを構築しました。それは素晴らしい働きをします。API呼び出しの費用が847ドル/月で、 2かかります。1 つのレビューを分類するのに3 秒かかります。「スマート」ドキュメント分類器は、3ドル、200/月を消費します。チャットボットの機能は?$15、000/月、そしてカウントされています。

共有された痛み:

- 価値を生み出すよりも早く予算を枯渇させる肥大化した AI 機能

- ユーザーエクスペリエンスを損なう高遅延(「スマート」な応答を 3 秒も待たない)

- 機密データがネットワークから離れなければならない場合のプライバシーに関する懸念

- 独自のデータがサードパーティの API を経由する場合のコンプライアンスの悪夢

- 大規模なリモートのみのモデルに縛られることによる開発者の摩擦

Remocal + 実行可能な最小モデル = スイートスポット

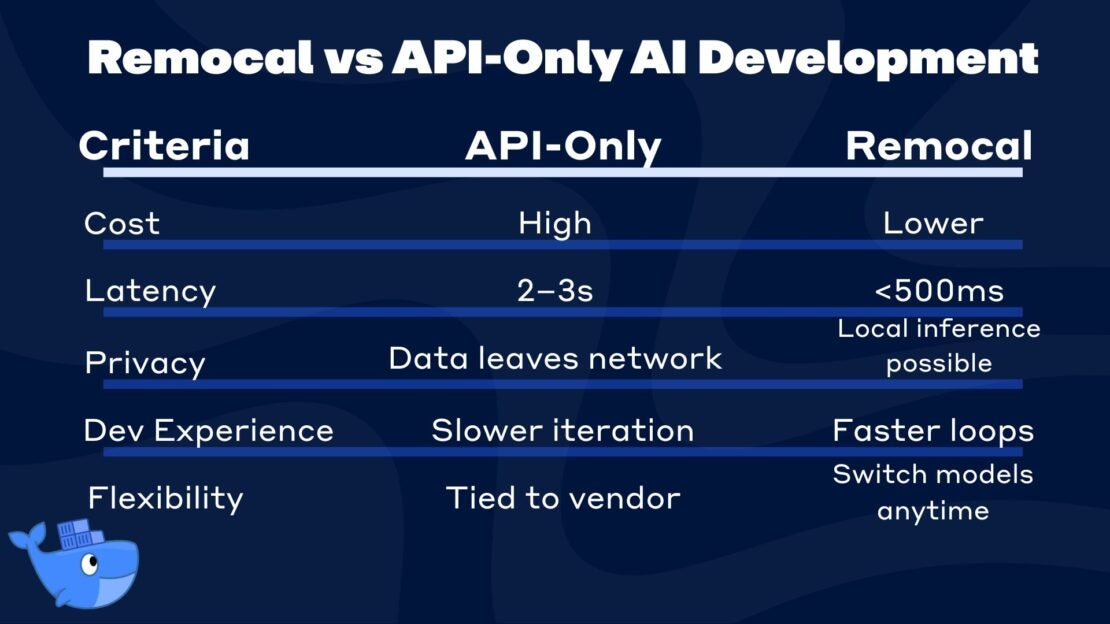

Remocal (リモート + ローカル) は、ローカル開発環境とクラウド リソースへのオンデマンド アクセスを組み合わせた新しいハイブリッド開発アプローチであり、開発者は必要に応じて強力なリモート コンピューティングをシームレスに活用しながらローカルで作業できるようにします。このアプローチは、現実的なテストのためにステージング環境にデプロイする際の摩擦を排除し、複雑なクラウド設定を管理するオーバーヘッドを削減し、使い慣れたローカル開発ワークフローを離れることなく本番規模のリソースに即座にアクセスできるようにすることで、従来の開発における長年の問題を解決します。

これは、アクセス可能なローカル反復と大規模な最新の AI モデルの実質的な計算要件との間の基本的な緊張に対処するため、AI 開発に特に効果的です。Remocalを使用すると、開発者はローカルモデルを使用して、エージェントをローカルで構築およびテストできます。また、AI のユースケースやワークロードがローカルの実行可能性を超えた場合に、クラウド GPU にバーストアウトすることもできます。これにより、最小限のリソースで AI アプリケーションをより簡単かつ安価に構築できるようになり、AI 開発が民主化されると信じています。企業にとって、AI開発に対するRemocalのアプローチは、機械学習アプリケーションを構築するためのはるかに手頃な道筋と、より迅速な反復を可能にし、フラストレーションの少ない開発者エクスペリエンスを大幅に向上させます。

Remocalは、ローカルで開発し、必要な場合にのみクラウド加速で馬力を追加することを教えてくれます。この原則の論理的でますます重要な拡張は、最小実行可能モデル (MVM) です。

一言で言えば、実用最小モデル (MVM) とは、中核となるビジネス上の問題を効果的に解決する、最小かつ最も効率的なモデルをデプロイすることを意味します。また、クラウドにモデルをデプロイするための優れたガイダンスでもあります。大規模なKubernetesクラスターを、必要になるかなり前にスピンアップしたり、アプリケーションをテストするためだけにクラウドで巨大なPostgreSQLインスタンスを起動したりすることは決してありません。MVMとRemocalソフトウェア開発を組み合わせると、両方の長所を生かすことができます。

適切なサイズのモデルが活躍している理由

実際、ローカルモデルでPOCを構築できない場合は、今日のローカルモデルは、開発段階で大多数のAIアプリケーションが必要とするほぼすべてのものを処理できるため、何を構築するかを真剣に検討する必要があります。AI 研究者は、機能を失うことなくモデルを縮小するための次のような賢い方法を数多く考え出しました。

キュレーションされたデータ SLM (小規模言語モデル): Microsoft の最新の Phi4 ファミリは、慎重にフィルタリングされた高品質のトレーニング コーパスにより、サブ15B モデルが言語、コーディング、数学のベンチマークではるかに大規模なモデルに匹敵するか、はるかに大きなモデルに匹敵するか、それを上回ることができ、メモリと遅延のニーズを削減できることを示しています。

量子化: 重みをNF4 4ビットブロックと低ランクのアダプターレイヤーにパックすることで、精度を~1 pt以内に維持しながら、GPU RAMを~75%削減し、ラップトップクラスのトレーニングや推論を可能にします。

スパース・ミックス・オブ・エキスパート(MoE):Mistral の Mixtral 8×7B などのアーキテクチャは、各トークンを 8 つのエキスパート ブロックのうち 2 つだけ経由してルーティングし、ステップごとに <25% のパラメーターをアクティブにしますが、高密度のピアに一致するため、サービング コストは合計ではなくアクティブなパラメーターによってスケールします。

メモリ効率の高いアテンションカーネル: FlashAttention-2 のようなライブラリは、読み取り/書き込みを並べ替えて、アテンションがオンチップSRAMに収まるようにし、スループットを2倍にし、コモディティGPUでより大きなコンテキストウィンドウを可能にします。

デバイス上の「ナノ」モデル: Google の Gemini Nano は Chrome と Android に直接搭載されており、サブ4B モデルがクラウド通話なしで携帯電話やブラウザでプライベートで低遅延の推論を実行できることを証明しています。

MVM対応の量産対応モデル

MVM 対応モデル

|

モデル |

サイズ (B パラメータ) |

得意なこと |

一般的なハードウェアの設置面積* |

なぜその重量を超えるパンチを打つのか |

|---|---|---|---|---|

|

32B |

デュアルモード推論(思考/非思考)、多言語(119 言語)、ロングコンテキスト(32K-128K)、ツール呼び出し |

RTX 4090 またはH100;~64GB VRAM 全精度、~16GB ( 4ビット量子化) |

ハイブリッド思考モードでは、迅速な応答と深い推論を切り替えることができます。コーディングと数学に関するはるかに大規模なモデルと競争力がある |

|

|

27B |

マルチモーダル (テキスト + 画像)、 140+ 言語、関数呼び出し、 128K コンテキスト |

シングル H100 または RTX 3090 (24GB);~54GB の全精度、~7GB (int4 量子化あり) |

DeepSeek-R1のパフォーマンスの 98% を、1 GPU と 32のみで達成します。最適化された量子化により、4x 圧縮で品質を維持 |

|

|

24B |

高速推論(150 トークン/秒)、マルチモーダル、関数呼び出し、命令追従 |

RTX 4090 または A100;~55GB VRAM bf16/fp16、 ~14GB (量子化あり) |

ラマ3より3倍速い。3 70B;安定性が向上し、繰り返し出力が減少しました。低遅延アプリケーション向けに最適化 |

|

|

~70 B |

テキスト + 新興マルチモーダル、ロングコンテキスト (128 K トークン) |

4ビット量子化モード(~45GB VRAM)の大型デスクトップ |

15T 高品質トークンでトレーニングされ、ベンチマークで競争力があり、RAG/エージェント パイプラインにうまく統合され、多用途です |

|

|

3B |

デュアルモード推論、多言語(6 言語)、ロングコンテキスト(128K)、ツール呼び出し |

RTX 3060 または控えめなハードウェア。~6GB VRAM、ラップトップおよびエッジデバイスで動作 |

B サイズにもかかわらず 4B+ モデルと競合 3。グループ化されたクエリアテンションと最適化されたトレーニングカリキュラムを備えた効率的なアーキテクチャ |

|

|

14B |

複雑な推論、数学、コーディング、一般的なチャット |

4ビット≈ 10-15 GB VRAM;RTX 4090またはH100で動作 |

9で訓練した。合成データと厳密なフィルタリングを備えた8T トークン。ラマ3を凌駕する。3 705x 小さいながら、数学/推論タスクで B |

ハードウェアフットプリントに関する注意事項: 要件は、量子化レベルとコンテキストの長さによって大きく異なります。全精度の数値は、bf16/fp16を前提としています。量子化されたモデル(4ビット/8ビット)は、品質の低下を最小限に抑えながら、メモリ要件を 2〜4倍削減できます。適切な最適化により、より小さなモデルでもエッジ展開が可能です。

どちらかといえば、有効性を維持しながらモデルを縮小する取り組みはまだ始まったばかりであるため、将来的には Remocal + MVM がさらに実行可能になり、現在適用できないユースケースをより広範囲にカバーできるようになります。現在も、問題なくローカルで実行できる高性能モデルが多数あります。一部の開発者は、ブラウザベースの AI 機能を活用するアプリやライブラリの構築を検討しています。時間が経つにつれて、これは、以前のモデルと同じハードウェアで実行できるより優れたモデルを意味します。

今日でも、超能力を備えたこれらの新しい小さなモデルは、NLP、マシンビジョン、一般的な言語モデルなど、あらゆる機能とツールの使用を表しています。小さなモデルの微調整されたバージョンが HuggingFace で出現し続けるにつれて (Docker Model Runner に事前にパッケージ化されている) ため、多様性が高まると予想されます。

そうは言っても、MVM でのローカル開発が最初のステップにすぎず、より大きなモデルやより強力な GPU へのアクセス、または AI トレーニングや推論クラスターへのアクセスが不可欠であるユースケースはたくさんあります。Remocal + MVMは、日常業務のための高速でコスト効率の高いローカル推論と、複雑さの限界に達したときの強力なクラウドモデルへのスムーズなアクセスという、両方の長所を提供します。このハイブリッド アプローチにより、ローカル ハードウェアでプロトタイプを作成して迅速に反復し、要求の厳しいワークロードに対応するフロンティア モデルにシームレスに拡張できるのが、すべて同じ開発環境内で実行できます。ローカルのみの制約やクラウドのみのコストに縛られることはありません。代わりに、タスクごとに適切なモデルサイズを自動的に使用するインテリジェントなリソース割り当てが得られ、AIパイプライン全体のパフォーマンスと経済性の両方が最適化されます。

ローカルモデルとAPIジャイアントのルーブリック

そうは言っても、Remocal + MVMは特定の状況では機能しない場合があります。完全な製品要件仕様を実行して、ユースケースを明確にし、MVM が構築を計画しているものにとって実行可能なアプローチであることを確認することが重要です。

次の場合にAPIモデルを使い続ける:

- 幅広い世界の知識や時事問題が必要です

- 多様な領域にわたる複雑で多段階の推論が必要です

- 汎用の会話型 AI を構築しています

- 毎月 1件未満のリクエストが000 件未満です

- 2-5%の精度向上により、100倍のコストが正当化されます。

適切なサイズのモデルは、次の場合に使用します。

- タスクが明確に定義されている (分類、コード補完、ドキュメント処理)

- 一貫性のある低レイテンシーの応答が必要です

- 推論あたりのコストは、ビジネスモデルにとって重要です

- データのプライバシーまたはコンプライアンスが懸念される

- 開発者を API レート制限から独立させる必要がある

古典的な 80/20 べき乗則は、Remocal + MVMに適用されます。ほとんどの本番 AI アプリケーションは、適切なサイズのモデルが、より高速、より優れた柔軟性、より優れたセキュリティで、わずかなコストで大規模モデルとほぼ同等のパフォーマンスを達成できる、明確に定義されたカテゴリに分類されます。

結論: 実用 AI の夜明け

AI における「大きいほど常に良い」という時代は、適切な仕事に適したモデルと、「より具体的な仕事のための小さなツール」という「Unix」の考え方という、より微妙な理解に取って代わられつつあります。Microsoft の Phi-4 が 14B パラメータ パッケージで GPT4o-mini レベルのパフォーマンスを実現し、Gemini Nano がブラウザで高度な AI を直接実行することで、AI 機能の民主化を目の当たりにしています。つまり、まともなラップトップを持っている開発者なら誰でも、洗練された AI アプリケーションを構築できます。

AI に対する Remocal + 最小実行可能モデルのアプローチは、コスト削減にとどまりません。また、以前は Platform チームと MLOps チームを悩ませていた制御、柔軟性、イテレーションのペース、開発者エクスペリエンスに関する問題も解決します。このアプローチにより、1,000 の AI アプリが開花することも可能になり、仕様に合わせて構築したり、一瞬で変更したりすることがはるかに簡単になります。出発点として、ローカル AI 開発は、セキュリティの向上、コンプライアンスの向上、リスクの最小化を意味します。これは、AI のセキュリティとコンプライアンスの経験がない大多数の開発者にとって特に重要です。

カスタマー サービス チャットボット、コード補完ツール、ドキュメント アナライザーのいずれを構築する場合でも、クラウド API の複雑さ、コスト、プライバシーの懸念なしにユースケースを処理できる、小規模で効率的なモデルが存在する可能性があります。その後、適切な時期が来て、アプリケーションがそれを必要とするときに、組織はAIワークロードをクラウド内のより強力なGPUクラスターにバーストして、トレーニングと推論を行うことができます。必要に応じて、オンデマンドで、より大きく、より強力なモデルに切り替えることができます。AI 開発におけるローカルとクラウドは、 100% 間違った選択です。実際、ほとんどの組織は、小規模なローカルモデルで高速、機敏、自律的なツールを開発者に提供し、アプリケーションやユースケースで必要に応じて大規模なクラウドGPUと最先端のモデルAPIにバーストする能力を提供するため、両方を備えた方が良いです。

未来は、ローカルの効率性とクラウドの規模を戦略的に組み合わせ、実行可能な最小限のモデルを使用して、仕事を成し遂げることができる組織に属します。ローカルから始めて価値を証明し、戦略的に拡張します。